-

openEuler-22.03-LTS部署kubernetes 一、安装要求 在开始之前,部署Kubernetes集群机器需要满足以下几个条件: • 一台或多台机器,操作系统 欧拉系统 • 硬件配置:2GB或更多RAM,2个CPU或更多CPU,硬盘30GB或更多 • 集群中所有机器之间网络互通 • 可以访问外网,需要拉取镜像 • 禁止swap分区 1.2 主机硬件配置说明 CPU 内存 角色 主机名 4C 4G Master k8s-master 4C 4G Node01 k8s-node01 4C 4G Node02 k8s-node02 二、主机准备 2.1 主机名配置 由于本次使用3台主机完成kubernetes集群部署,其中1台为master节点,名称为k8s-master01;其中2台为node节点,名称分别为:k8s-node01及k8s-node02 master节点 hostnamectl set-hostname k8s-master01 node01节点 hostnamectl set-hostname k8s-node01 node02节点 hostnamectl set-hostname k8s-node02 在master添加hosts: cat >> /etc/hosts << EOF 192.168.10.1 k8s-master 192.168.10.2 k8s-node1 192.168.10.3 k8s-node2 EOF 2.2 主机IP地址配置 k8s-master01节点IP地址为:192.168.10.1/24 vim /etc/sysconfig/network-scripts/ifcfg-ens33 TYPE="Ethernet" PROXY_METHOD="none" BROWSER_ONLY="no" BOOTPROTO="none" DEFROUTE="yes" IPV4_FAILURE_FATAL="no" IPV6INIT="yes" IPV6_AUTOCONF="yes" IPV6_DEFROUTE="yes" IPV6_FAILURE_FATAL="no" IPV6_ADDR_GEN_MODE="stable-privacy" NAME="ens33" DEVICE="ens33" ONBOOT="yes" IPADDR="192.168.10.1" PREFIX="24" GATEWAY="192.168.10.254" DNS1="8.8.8.8" k8s-node01节点IP地址为:192.168.10.2/24 vim /etc/sysconfig/network-scripts/ifcfg-ens33 TYPE="Ethernet" PROXY_METHOD="none" BROWSER_ONLY="no" BOOTPROTO="none" DEFROUTE="yes" IPV4_FAILURE_FATAL="no" IPV6INIT="yes" IPV6_AUTOCONF="yes" IPV6_DEFROUTE="yes" IPV6_FAILURE_FATAL="no" IPV6_ADDR_GEN_MODE="stable-privacy" NAME="ens33" DEVICE="ens33" ONBOOT="yes" IPADDR="192.168.10.2" PREFIX="24" GATEWAY="192.168.10.254" DNS1="8.8.8.8" k8s-node02节点IP地址为:192.168.10.3/24 vim /etc/sysconfig/network-scripts/ifcfg-ens33 TYPE="Ethernet" PROXY_METHOD="none" BROWSER_ONLY="no" BOOTPROTO="none" DEFROUTE="yes" IPV4_FAILURE_FATAL="no" IPV6INIT="yes" IPV6_AUTOCONF="yes" IPV6_DEFROUTE="yes" IPV6_FAILURE_FATAL="no" IPV6_ADDR_GEN_MODE="stable-privacy" NAME="ens33" DEVICE="ens33" ONBOOT="yes" IPADDR="192.168.10.3" PREFIX="24" GATEWAY="192.168.10.254" DNS1="8.8.8.8" 2.3 主机名与IP地址解析 所有集群主机均需要进行配置。 cat /etc/hosts 127.0.0.1 localhost localhost.localdomain localhost4 localhost4.localdomain4 ::1 localhost localhost.localdomain localhost6 localhost6.localdomain6 192.168.10.1 k8s-master01 192.168.10.2 k8s-node01 192.168.10.3 k8s-node02 2.4 防火墙配置 所有主机均需要操作。 关闭现有防火墙firewalld systemctl disable firewalld systemctl stop firewalld firewall-cmd --state not running 2.5 SELINUX配置 所有主机均需要操作。修改SELinux配置需要重启操作系统。 sed -ri 's/SELINUX=enforcing/SELINUX=disabled/' /etc/selinux/config 2.6 时间同步配置 所有主机均需要操作。最小化安装系统需要安装ntpdate软件。 yum install ntpdate -y ntpdate time1.aliyun.com 修改时区 ln -sf /usr/share/zoneinfo/Asia/Shanghai /etc/localtime 修改语言 sudo echo 'LANG="en_US.UTF-8"' >> /etc/profile;source /etc/profile 2.7 配置内核转发及网桥过滤 所有主机均需要操作。 将桥接的IPv4流量传递到iptables的链: cat > /etc/sysctl.d/k8s.conf << EOF net.bridge.bridge-nf-call-ip6tables = 1 net.bridge.bridge-nf-call-iptables = 1 net.bridge.bridge-nf-call-iptables=1 net.bridge.bridge-nf-call-ip6tables=1 net.ipv4.ip_forward=1 net.ipv4.tcp_tw_recycle=0 vm.swappiness=0 vm.overcommit_memory=1 vm.panic_on_oom=0 fs.inotify.max_user_instances=8192 fs.inotify.max_user_watches=1048576 fs.file-max=52706963 fs.nr_open=52706963 net.ipv6.conf.all.disable_ipv6=1 net.netfilter.nf_conntrack_max=2310720 EOF sysctl --system 开启内核路由转发 vi /etc/sysctl.conf net.ipv4.ip_forward=1 添加网桥过滤及内核转发配置文件 cat /etc/sysctl.d/k8s.conf net.bridge.bridge-nf-call-ip6tables = 1 net.bridge.bridge-nf-call-iptables = 1 vm.swappiness = 0 加载br_netfilter模块 modprobe br_netfilter 查看是否加载 lsmod | grep br_netfilter br_netfilter 22256 0 bridge 151336 1 br_netfilter 使用默认配置文件生效 sysctl -p 使用新添加配置文件生效 sysctl -p /etc/sysctl.d/k8s.conf 2.8 安装ipset及ipvsadm 所有主机均需要操作。 安装ipset及ipvsadm yum -y install ipset ipvsadm 配置ipvsadm模块加载方式 添加需要加载的模块 cat > /etc/sysconfig/modules/ipvs.modules <<EOF #!/bin/bash modprobe -- ip_vs modprobe -- ip_vs_rr modprobe -- ip_vs_wrr modprobe -- ip_vs_sh modprobe -- nf_conntrack EOF 授权、运行、检查是否加载 chmod 755 /etc/sysconfig/modules/ipvs.modules && bash /etc/sysconfig/modules/ipvs.modules && lsmod | grep -e ip_vs -e nf_conntrack 2.9 关闭SWAP分区 修改完成后需要重启操作系统,如不重启,可临时关闭,命令为swapoff -a 临时关闭 swapoff -a 永远关闭swap分区,需要重启操作系统 cat /etc/fstab ...... # /dev/mapper/openeuler-swap none swap defaults 0 0 在上一行中行首添加# 三、容器运行时工具安装及运行 查看是否存在docker软件 yum list | grep docker pcp-pmda-docker.x86_64 5.3.7-2.oe2203sp1 docker-client-java.noarch 8.11.7-2.oe2203sp1 docker-client-java.src 8.11.7-2.oe2203sp1 docker-compose.noarch 1.22.0-4.oe2203sp1 docker-compose.src 1.22.0-4.oe2203sp1 docker-engine.src 2:18.09.0-316.oe220 docker-engine.x86_64 2:18.09.0-316.oe220 docker-engine.x86_64 2:18.09.0-316.oe220 docker-engine-debuginfo.x86_64 2:18.09.0-316.oe220 docker-engine-debugsource.x86_64 2:18.09.0-316.oe220 docker-runc.src 1.1.3-9.oe2203sp1 docker-runc.x86_64 1.1.3-9.oe2203sp1 podman-docker.noarch 1:0.10.1-12.oe2203s python-docker.src 5.0.3-1.oe2203sp1 python-docker-help.noarch 5.0.3-1.oe2203sp1 python-docker-pycreds.src 0.4.0-2.oe2203sp1 python-dockerpty.src 0.4.1-3.oe2203sp1 python-dockerpty-help.noarch 0.4.1-3.oe2203sp1 python3-docker.noarch 5.0.3-1.oe2203sp1 python3-docker-pycreds.noarch 0.4.0-2.oe2203sp1 python3-dockerpty.noarch 0.4.1-3.oe2203sp1 安装docker dnf install docker Last metadata expiration check: 0:53:18 ago on Dependencies resolved. =============================================================================== Package Architecture Version Repository Size =============================================================================== Installing: docker-engine x86_64 2:18.09.0-316.oe2203sp1 OS 38 M Installing dependencies: libcgroup x86_64 0.42.2-3.oe2203sp1 OS Transaction Summary =============================================================================== Install 2 Packages Total download size: 39 M Installed size: 160 M Is this ok : y Downloading Packages: (1/2): libcgroup-0.42.2-3.oe2203sp1.x86_64.rpm 396 kB/s | 96 kB 00:00 (2/2): docker-engine-18.09.0-316.oe2203sp1.x86_64.rpm 10 MB/s | 38 MB 00:03 -------------------------------------------------------------------------------- Total 10 MB/s | 39 MB 00:03 Running transaction check Transaction check succeeded. Running transaction test Transaction test succeeded. Running transaction Preparing : 1/1 Running scriptlet: libcgroup-0.42.2-3.oe2203sp1.x86_64 1/2 Installing : libcgroup-0.42.2-3.oe2203sp1.x86_64 1/2 Running scriptlet: libcgroup-0.42.2-3.oe2203sp1.x86_64 1/2 Installing : docker-engine-2:18.09.0-316.oe2203sp1.x86_64 2/2 Running scriptlet: docker-engine-2:18.09.0-316.oe2203sp1.x86_64 2/2 Created symlink /etc/systemd/system/multi-user.target.wants/docker.service → /usr/lib/systemd/system/docker.service. Verifying : docker-engine-2:18.09.0-316.oe2203sp1.x86_64 1/2 Verifying : libcgroup-0.42.2-3.oe2203sp1.x86_64 2/2 Installed: docker-engine-2:18.09.0-316.oe2203sp1.x86_64 libcgroup-0.42.2-3.oe2203sp1.x86_64 Complete! 设置docker开机启动并启动 systemctl enable --now docker 查看docker版本 docker version Client: Version: 18.09.0 EulerVersion: 18.09.0.316 API version: 1.39 Go version: go1.17.3 Git commit: 9b9af2f Built: Tue Dec 27 14:25:30 2022 OS/Arch: linux/amd64 Experimental: false Server: Engine: Version: 18.09.0 EulerVersion: 18.09.0.316 API version: 1.39 (minimum version 1.12) Go version: go1.17.3 Git commit: 9b9af2f Built: Tue Dec 27 14:24:56 2022 OS/Arch: linux/amd64 Experimental: false 四、K8S软件安装 安装k8s依赖,连接跟踪 dnf install conntrack k8s master节点安装 dnf install -y kubernetes-kubeadm kubernetes-kubelet kubernetes-master k8s worker节点安装 dnf install -y kubernetes-kubeadm kubernetes-kubelet kubernetes-node systemctl enable kubelet 五、K8S集群初始化master kubeadm init --apiserver-advertise-address=192.168.10.1 --image-repository registry.aliyuncs.com/google_containers --kubernetes-version v1.20.2 --service-cidr=10.1.0.0/16 --pod-network-cidr=10.244.0.0/16 输出: Using Kubernetes version: v1.20.2 Running pre-flight checks : detected "cgroupfs" as the Docker cgroup driver. The recommended driver is "systemd". Please follow the guide at https://kubernetes.io/docs/setup/cri/ : socat not found in system path Pulling images required for setting up a Kubernetes cluster This might take a minute or two, depending on the speed of your internet connection You can also perform this action in beforehand using 'kubeadm config images pull' Using certificateDir folder "/etc/kubernetes/pki" Generating "ca" certificate and key Generating "apiserver" certificate and key apiserver serving cert is signed for DNS names and IPs Generating "apiserver-kubelet-client" certificate and key Generating "front-proxy-ca" certificate and key Generating "front-proxy-client" certificate and key Generating "etcd/ca" certificate and key Generating "etcd/server" certificate and key etcd/server serving cert is signed for DNS names and IPs Generating "etcd/peer" certificate and key etcd/peer serving cert is signed for DNS names and IPs Generating "etcd/healthcheck-client" certificate and key Generating "apiserver-etcd-client" certificate and key Generating "sa" key and public key Using kubeconfig folder "/etc/kubernetes" Writing "admin.conf" kubeconfig file Writing "kubelet.conf" kubeconfig file Writing "controller-manager.conf" kubeconfig file Writing "scheduler.conf" kubeconfig file Writing kubelet environment file with flags to file "/var/lib/kubelet/kubeadm-flags.env" Writing kubelet configuration to file "/var/lib/kubelet/config.yaml" Starting the kubelet Using manifest folder "/etc/kubernetes/manifests" Creating static Pod manifest for "kube-apiserver" Creating static Pod manifest for "kube-controller-manager" Creating static Pod manifest for "kube-scheduler" Creating static Pod manifest for local etcd in "/etc/kubernetes/manifests" Waiting for the kubelet to boot up the control plane as static Pods from directory "/etc/kubernetes/manifests". This can take up to 4m0s All control plane components are healthy after 6.502722 seconds Storing the configuration used in ConfigMap "kubeadm-config" in the "kube-system" Namespace Creating a ConfigMap "kubelet-config-1.20" in namespace kube-system with the configuration for the kubelets in the cluster Skipping phase. Please see --upload-certs Marking the node k8s-master01 as control-plane by adding the labels "node-role.kubernetes.io/master=''" and "node-role.kubernetes.io/control-plane='' (deprecated)" Marking the node k8s-master01 as control-plane by adding the taints Using token: jvx2bb.pfd31288qyqcfsn7 Configuring bootstrap tokens, cluster-info ConfigMap, RBAC Roles configured RBAC rules to allow Node Bootstrap tokens to get nodes configured RBAC rules to allow Node Bootstrap tokens to post CSRs in order for nodes to get long term certificate credentials configured RBAC rules to allow the csrapprover controller automatically approve CSRs from a Node Bootstrap Token configured RBAC rules to allow certificate rotation for all node client certificates in the cluster Creating the "cluster-info" ConfigMap in the "kube-public" namespace Updating "/etc/kubernetes/kubelet.conf" to point to a rotatable kubelet client certificate and key Applied essential addon: CoreDNS Applied essential addon: kube-proxy Your Kubernetes control-plane has initialized successfully! To start using your cluster, you need to run the following as a regular user: mkdir -p $HOME/.kube sudo cp -i /etc/kubernetes/admin.conf $HOME/.kube/config sudo chown $(id -u):$(id -g) $HOME/.kube/config Alternatively, if you are the root user, you can run: export KUBECONFIG=/etc/kubernetes/admin.conf You should now deploy a pod network to the cluster. Run "kubectl apply -f .yaml" with one of the options listed at: https://kubernetes.io/docs/concepts/cluster-administration/addons/ Then you can join any number of worker nodes by running the following on each as root: kubeadm join 192.168.10.1:6443 --token jvx2bb.pfd31288qyqcfsn7 \ --discovery-token-ca-cert-hash sha256:740fa71f6c5acf156195ce6989cb49b7a64fd061b8bf56e4b1b684cbedafbd40 # mkdir -p $HOME/.kube # sudo cp -i /etc/kubernetes/admin.conf $HOME/.kube/config # sudo chown $(id -u):$(id -g) $HOME/.kube/config 六、K8S集群工作节点加入 kubeadm join 192.168.10.1:6443 --token jvx2bb.pfd31288qyqcfsn7 \ --discovery-token-ca-cert-hash sha256:740fa71f6c5acf156195ce6989cb49b7a64fd061b8bf56e4b1b684cbedafbd40 # kubeadm join 192.168.10.1:6443 --token jvx2bb.pfd31288qyqcfsn7 \ --discovery-token-ca-cert-hash sha256:740fa71f6c5acf156195ce6989cb49b7a64fd061b8bf56e4b1b684cbedafbd40 # kubectl get nodes NAME STATUS ROLES AGE VERSION k8s-master01 NotReady control-plane,master 3m59s v1.20.2 k8s-node01 NotReady <none> 18s v1.20.2 k8s-node02 NotReady <none> 10s v1.20.2 七、K8S集群网络插件使用 # wget https://docs.projectcalico.org/v3.19/manifests/calico.yaml 由于网络问题,我这边使用离线方式安装插件calico 1. 去github上面下载自己所需的calico离线包,项目地址: https://github.com/projectcalico/calico 2. 假设要安装最新版本v3.28.0,首先可以下载这个版本的calico.yaml,具体命令是 curl -O -L https://raw.githubusercontent.com/projectcalico/calico/v3.28.0/manifests/calico.yaml 3. 下载完成之后可以通过calico.yaml查看需要安装哪些离线包,命令是: cat calico.yaml | grep image image: docker.io/calico/cni:v3.28.0 imagePullPolicy: IfNotPresent image: docker.io/calico/cni:v3.28.0 imagePullPolicy: IfNotPresent image: docker.io/calico/node:v3.28.0 imagePullPolicy: IfNotPresent image: docker.io/calico/node:v3.28.0 imagePullPolicy: IfNotPresent image: docker.io/calico/kube-controllers:v3.28.0 imagePullPolicy: IfNotPresent 4. 通过上述命令,查看到需要安装calico-cni.tar, calico-kube-controllers.tar 和 calico-node.tar三个包,然后需要将这三个包导入到k8s的命名空间中 使用导入命令将这三个包导入到k8s的命名空间中: docker load -i calico-cni.tar docker load -i calico-node.tar docker load -i calico-kube-controllers.tar 5. 导入之后就可以apply calico.yaml 文件了 6. 导入之后查看calico的pod,发现calico和coredns已经起来了 kubectl get pods -n kube-system NAME READY STATUS RESTARTS AGE calico-kube-controllers-8d76c5f9b-brv86 1/1 Running 0 22h calico-node-hxks2 1/1 Running 0 22h coredns-66f779496c-9hqsx 1/1 Running 0 23h coredns-66f779496c-rcc74 1/1 Running 0 23h etcd-kevin-pc 1/1 Running 4 (28m ago) 23h kube-apiserver-kevin-pc 1/1 Running 4 (28m ago) 23h kube-controller-manager-kevin-pc 1/1 Running 4 (28m ago) 23h kube-proxy-gglh4 1/1 Running 1 (28m ago) 23h kube-scheduler-kevin-pc 1/1 Running 4 (28m ago) 23h

openEuler-22.03-LTS部署kubernetes 一、安装要求 在开始之前,部署Kubernetes集群机器需要满足以下几个条件: • 一台或多台机器,操作系统 欧拉系统 • 硬件配置:2GB或更多RAM,2个CPU或更多CPU,硬盘30GB或更多 • 集群中所有机器之间网络互通 • 可以访问外网,需要拉取镜像 • 禁止swap分区 1.2 主机硬件配置说明 CPU 内存 角色 主机名 4C 4G Master k8s-master 4C 4G Node01 k8s-node01 4C 4G Node02 k8s-node02 二、主机准备 2.1 主机名配置 由于本次使用3台主机完成kubernetes集群部署,其中1台为master节点,名称为k8s-master01;其中2台为node节点,名称分别为:k8s-node01及k8s-node02 master节点 hostnamectl set-hostname k8s-master01 node01节点 hostnamectl set-hostname k8s-node01 node02节点 hostnamectl set-hostname k8s-node02 在master添加hosts: cat >> /etc/hosts << EOF 192.168.10.1 k8s-master 192.168.10.2 k8s-node1 192.168.10.3 k8s-node2 EOF 2.2 主机IP地址配置 k8s-master01节点IP地址为:192.168.10.1/24 vim /etc/sysconfig/network-scripts/ifcfg-ens33 TYPE="Ethernet" PROXY_METHOD="none" BROWSER_ONLY="no" BOOTPROTO="none" DEFROUTE="yes" IPV4_FAILURE_FATAL="no" IPV6INIT="yes" IPV6_AUTOCONF="yes" IPV6_DEFROUTE="yes" IPV6_FAILURE_FATAL="no" IPV6_ADDR_GEN_MODE="stable-privacy" NAME="ens33" DEVICE="ens33" ONBOOT="yes" IPADDR="192.168.10.1" PREFIX="24" GATEWAY="192.168.10.254" DNS1="8.8.8.8" k8s-node01节点IP地址为:192.168.10.2/24 vim /etc/sysconfig/network-scripts/ifcfg-ens33 TYPE="Ethernet" PROXY_METHOD="none" BROWSER_ONLY="no" BOOTPROTO="none" DEFROUTE="yes" IPV4_FAILURE_FATAL="no" IPV6INIT="yes" IPV6_AUTOCONF="yes" IPV6_DEFROUTE="yes" IPV6_FAILURE_FATAL="no" IPV6_ADDR_GEN_MODE="stable-privacy" NAME="ens33" DEVICE="ens33" ONBOOT="yes" IPADDR="192.168.10.2" PREFIX="24" GATEWAY="192.168.10.254" DNS1="8.8.8.8" k8s-node02节点IP地址为:192.168.10.3/24 vim /etc/sysconfig/network-scripts/ifcfg-ens33 TYPE="Ethernet" PROXY_METHOD="none" BROWSER_ONLY="no" BOOTPROTO="none" DEFROUTE="yes" IPV4_FAILURE_FATAL="no" IPV6INIT="yes" IPV6_AUTOCONF="yes" IPV6_DEFROUTE="yes" IPV6_FAILURE_FATAL="no" IPV6_ADDR_GEN_MODE="stable-privacy" NAME="ens33" DEVICE="ens33" ONBOOT="yes" IPADDR="192.168.10.3" PREFIX="24" GATEWAY="192.168.10.254" DNS1="8.8.8.8" 2.3 主机名与IP地址解析 所有集群主机均需要进行配置。 cat /etc/hosts 127.0.0.1 localhost localhost.localdomain localhost4 localhost4.localdomain4 ::1 localhost localhost.localdomain localhost6 localhost6.localdomain6 192.168.10.1 k8s-master01 192.168.10.2 k8s-node01 192.168.10.3 k8s-node02 2.4 防火墙配置 所有主机均需要操作。 关闭现有防火墙firewalld systemctl disable firewalld systemctl stop firewalld firewall-cmd --state not running 2.5 SELINUX配置 所有主机均需要操作。修改SELinux配置需要重启操作系统。 sed -ri 's/SELINUX=enforcing/SELINUX=disabled/' /etc/selinux/config 2.6 时间同步配置 所有主机均需要操作。最小化安装系统需要安装ntpdate软件。 yum install ntpdate -y ntpdate time1.aliyun.com 修改时区 ln -sf /usr/share/zoneinfo/Asia/Shanghai /etc/localtime 修改语言 sudo echo 'LANG="en_US.UTF-8"' >> /etc/profile;source /etc/profile 2.7 配置内核转发及网桥过滤 所有主机均需要操作。 将桥接的IPv4流量传递到iptables的链: cat > /etc/sysctl.d/k8s.conf << EOF net.bridge.bridge-nf-call-ip6tables = 1 net.bridge.bridge-nf-call-iptables = 1 net.bridge.bridge-nf-call-iptables=1 net.bridge.bridge-nf-call-ip6tables=1 net.ipv4.ip_forward=1 net.ipv4.tcp_tw_recycle=0 vm.swappiness=0 vm.overcommit_memory=1 vm.panic_on_oom=0 fs.inotify.max_user_instances=8192 fs.inotify.max_user_watches=1048576 fs.file-max=52706963 fs.nr_open=52706963 net.ipv6.conf.all.disable_ipv6=1 net.netfilter.nf_conntrack_max=2310720 EOF sysctl --system 开启内核路由转发 vi /etc/sysctl.conf net.ipv4.ip_forward=1 添加网桥过滤及内核转发配置文件 cat /etc/sysctl.d/k8s.conf net.bridge.bridge-nf-call-ip6tables = 1 net.bridge.bridge-nf-call-iptables = 1 vm.swappiness = 0 加载br_netfilter模块 modprobe br_netfilter 查看是否加载 lsmod | grep br_netfilter br_netfilter 22256 0 bridge 151336 1 br_netfilter 使用默认配置文件生效 sysctl -p 使用新添加配置文件生效 sysctl -p /etc/sysctl.d/k8s.conf 2.8 安装ipset及ipvsadm 所有主机均需要操作。 安装ipset及ipvsadm yum -y install ipset ipvsadm 配置ipvsadm模块加载方式 添加需要加载的模块 cat > /etc/sysconfig/modules/ipvs.modules <<EOF #!/bin/bash modprobe -- ip_vs modprobe -- ip_vs_rr modprobe -- ip_vs_wrr modprobe -- ip_vs_sh modprobe -- nf_conntrack EOF 授权、运行、检查是否加载 chmod 755 /etc/sysconfig/modules/ipvs.modules && bash /etc/sysconfig/modules/ipvs.modules && lsmod | grep -e ip_vs -e nf_conntrack 2.9 关闭SWAP分区 修改完成后需要重启操作系统,如不重启,可临时关闭,命令为swapoff -a 临时关闭 swapoff -a 永远关闭swap分区,需要重启操作系统 cat /etc/fstab ...... # /dev/mapper/openeuler-swap none swap defaults 0 0 在上一行中行首添加# 三、容器运行时工具安装及运行 查看是否存在docker软件 yum list | grep docker pcp-pmda-docker.x86_64 5.3.7-2.oe2203sp1 docker-client-java.noarch 8.11.7-2.oe2203sp1 docker-client-java.src 8.11.7-2.oe2203sp1 docker-compose.noarch 1.22.0-4.oe2203sp1 docker-compose.src 1.22.0-4.oe2203sp1 docker-engine.src 2:18.09.0-316.oe220 docker-engine.x86_64 2:18.09.0-316.oe220 docker-engine.x86_64 2:18.09.0-316.oe220 docker-engine-debuginfo.x86_64 2:18.09.0-316.oe220 docker-engine-debugsource.x86_64 2:18.09.0-316.oe220 docker-runc.src 1.1.3-9.oe2203sp1 docker-runc.x86_64 1.1.3-9.oe2203sp1 podman-docker.noarch 1:0.10.1-12.oe2203s python-docker.src 5.0.3-1.oe2203sp1 python-docker-help.noarch 5.0.3-1.oe2203sp1 python-docker-pycreds.src 0.4.0-2.oe2203sp1 python-dockerpty.src 0.4.1-3.oe2203sp1 python-dockerpty-help.noarch 0.4.1-3.oe2203sp1 python3-docker.noarch 5.0.3-1.oe2203sp1 python3-docker-pycreds.noarch 0.4.0-2.oe2203sp1 python3-dockerpty.noarch 0.4.1-3.oe2203sp1 安装docker dnf install docker Last metadata expiration check: 0:53:18 ago on Dependencies resolved. =============================================================================== Package Architecture Version Repository Size =============================================================================== Installing: docker-engine x86_64 2:18.09.0-316.oe2203sp1 OS 38 M Installing dependencies: libcgroup x86_64 0.42.2-3.oe2203sp1 OS Transaction Summary =============================================================================== Install 2 Packages Total download size: 39 M Installed size: 160 M Is this ok : y Downloading Packages: (1/2): libcgroup-0.42.2-3.oe2203sp1.x86_64.rpm 396 kB/s | 96 kB 00:00 (2/2): docker-engine-18.09.0-316.oe2203sp1.x86_64.rpm 10 MB/s | 38 MB 00:03 -------------------------------------------------------------------------------- Total 10 MB/s | 39 MB 00:03 Running transaction check Transaction check succeeded. Running transaction test Transaction test succeeded. Running transaction Preparing : 1/1 Running scriptlet: libcgroup-0.42.2-3.oe2203sp1.x86_64 1/2 Installing : libcgroup-0.42.2-3.oe2203sp1.x86_64 1/2 Running scriptlet: libcgroup-0.42.2-3.oe2203sp1.x86_64 1/2 Installing : docker-engine-2:18.09.0-316.oe2203sp1.x86_64 2/2 Running scriptlet: docker-engine-2:18.09.0-316.oe2203sp1.x86_64 2/2 Created symlink /etc/systemd/system/multi-user.target.wants/docker.service → /usr/lib/systemd/system/docker.service. Verifying : docker-engine-2:18.09.0-316.oe2203sp1.x86_64 1/2 Verifying : libcgroup-0.42.2-3.oe2203sp1.x86_64 2/2 Installed: docker-engine-2:18.09.0-316.oe2203sp1.x86_64 libcgroup-0.42.2-3.oe2203sp1.x86_64 Complete! 设置docker开机启动并启动 systemctl enable --now docker 查看docker版本 docker version Client: Version: 18.09.0 EulerVersion: 18.09.0.316 API version: 1.39 Go version: go1.17.3 Git commit: 9b9af2f Built: Tue Dec 27 14:25:30 2022 OS/Arch: linux/amd64 Experimental: false Server: Engine: Version: 18.09.0 EulerVersion: 18.09.0.316 API version: 1.39 (minimum version 1.12) Go version: go1.17.3 Git commit: 9b9af2f Built: Tue Dec 27 14:24:56 2022 OS/Arch: linux/amd64 Experimental: false 四、K8S软件安装 安装k8s依赖,连接跟踪 dnf install conntrack k8s master节点安装 dnf install -y kubernetes-kubeadm kubernetes-kubelet kubernetes-master k8s worker节点安装 dnf install -y kubernetes-kubeadm kubernetes-kubelet kubernetes-node systemctl enable kubelet 五、K8S集群初始化master kubeadm init --apiserver-advertise-address=192.168.10.1 --image-repository registry.aliyuncs.com/google_containers --kubernetes-version v1.20.2 --service-cidr=10.1.0.0/16 --pod-network-cidr=10.244.0.0/16 输出: Using Kubernetes version: v1.20.2 Running pre-flight checks : detected "cgroupfs" as the Docker cgroup driver. The recommended driver is "systemd". Please follow the guide at https://kubernetes.io/docs/setup/cri/ : socat not found in system path Pulling images required for setting up a Kubernetes cluster This might take a minute or two, depending on the speed of your internet connection You can also perform this action in beforehand using 'kubeadm config images pull' Using certificateDir folder "/etc/kubernetes/pki" Generating "ca" certificate and key Generating "apiserver" certificate and key apiserver serving cert is signed for DNS names and IPs Generating "apiserver-kubelet-client" certificate and key Generating "front-proxy-ca" certificate and key Generating "front-proxy-client" certificate and key Generating "etcd/ca" certificate and key Generating "etcd/server" certificate and key etcd/server serving cert is signed for DNS names and IPs Generating "etcd/peer" certificate and key etcd/peer serving cert is signed for DNS names and IPs Generating "etcd/healthcheck-client" certificate and key Generating "apiserver-etcd-client" certificate and key Generating "sa" key and public key Using kubeconfig folder "/etc/kubernetes" Writing "admin.conf" kubeconfig file Writing "kubelet.conf" kubeconfig file Writing "controller-manager.conf" kubeconfig file Writing "scheduler.conf" kubeconfig file Writing kubelet environment file with flags to file "/var/lib/kubelet/kubeadm-flags.env" Writing kubelet configuration to file "/var/lib/kubelet/config.yaml" Starting the kubelet Using manifest folder "/etc/kubernetes/manifests" Creating static Pod manifest for "kube-apiserver" Creating static Pod manifest for "kube-controller-manager" Creating static Pod manifest for "kube-scheduler" Creating static Pod manifest for local etcd in "/etc/kubernetes/manifests" Waiting for the kubelet to boot up the control plane as static Pods from directory "/etc/kubernetes/manifests". This can take up to 4m0s All control plane components are healthy after 6.502722 seconds Storing the configuration used in ConfigMap "kubeadm-config" in the "kube-system" Namespace Creating a ConfigMap "kubelet-config-1.20" in namespace kube-system with the configuration for the kubelets in the cluster Skipping phase. Please see --upload-certs Marking the node k8s-master01 as control-plane by adding the labels "node-role.kubernetes.io/master=''" and "node-role.kubernetes.io/control-plane='' (deprecated)" Marking the node k8s-master01 as control-plane by adding the taints Using token: jvx2bb.pfd31288qyqcfsn7 Configuring bootstrap tokens, cluster-info ConfigMap, RBAC Roles configured RBAC rules to allow Node Bootstrap tokens to get nodes configured RBAC rules to allow Node Bootstrap tokens to post CSRs in order for nodes to get long term certificate credentials configured RBAC rules to allow the csrapprover controller automatically approve CSRs from a Node Bootstrap Token configured RBAC rules to allow certificate rotation for all node client certificates in the cluster Creating the "cluster-info" ConfigMap in the "kube-public" namespace Updating "/etc/kubernetes/kubelet.conf" to point to a rotatable kubelet client certificate and key Applied essential addon: CoreDNS Applied essential addon: kube-proxy Your Kubernetes control-plane has initialized successfully! To start using your cluster, you need to run the following as a regular user: mkdir -p $HOME/.kube sudo cp -i /etc/kubernetes/admin.conf $HOME/.kube/config sudo chown $(id -u):$(id -g) $HOME/.kube/config Alternatively, if you are the root user, you can run: export KUBECONFIG=/etc/kubernetes/admin.conf You should now deploy a pod network to the cluster. Run "kubectl apply -f .yaml" with one of the options listed at: https://kubernetes.io/docs/concepts/cluster-administration/addons/ Then you can join any number of worker nodes by running the following on each as root: kubeadm join 192.168.10.1:6443 --token jvx2bb.pfd31288qyqcfsn7 \ --discovery-token-ca-cert-hash sha256:740fa71f6c5acf156195ce6989cb49b7a64fd061b8bf56e4b1b684cbedafbd40 # mkdir -p $HOME/.kube # sudo cp -i /etc/kubernetes/admin.conf $HOME/.kube/config # sudo chown $(id -u):$(id -g) $HOME/.kube/config 六、K8S集群工作节点加入 kubeadm join 192.168.10.1:6443 --token jvx2bb.pfd31288qyqcfsn7 \ --discovery-token-ca-cert-hash sha256:740fa71f6c5acf156195ce6989cb49b7a64fd061b8bf56e4b1b684cbedafbd40 # kubeadm join 192.168.10.1:6443 --token jvx2bb.pfd31288qyqcfsn7 \ --discovery-token-ca-cert-hash sha256:740fa71f6c5acf156195ce6989cb49b7a64fd061b8bf56e4b1b684cbedafbd40 # kubectl get nodes NAME STATUS ROLES AGE VERSION k8s-master01 NotReady control-plane,master 3m59s v1.20.2 k8s-node01 NotReady <none> 18s v1.20.2 k8s-node02 NotReady <none> 10s v1.20.2 七、K8S集群网络插件使用 # wget https://docs.projectcalico.org/v3.19/manifests/calico.yaml 由于网络问题,我这边使用离线方式安装插件calico 1. 去github上面下载自己所需的calico离线包,项目地址: https://github.com/projectcalico/calico 2. 假设要安装最新版本v3.28.0,首先可以下载这个版本的calico.yaml,具体命令是 curl -O -L https://raw.githubusercontent.com/projectcalico/calico/v3.28.0/manifests/calico.yaml 3. 下载完成之后可以通过calico.yaml查看需要安装哪些离线包,命令是: cat calico.yaml | grep image image: docker.io/calico/cni:v3.28.0 imagePullPolicy: IfNotPresent image: docker.io/calico/cni:v3.28.0 imagePullPolicy: IfNotPresent image: docker.io/calico/node:v3.28.0 imagePullPolicy: IfNotPresent image: docker.io/calico/node:v3.28.0 imagePullPolicy: IfNotPresent image: docker.io/calico/kube-controllers:v3.28.0 imagePullPolicy: IfNotPresent 4. 通过上述命令,查看到需要安装calico-cni.tar, calico-kube-controllers.tar 和 calico-node.tar三个包,然后需要将这三个包导入到k8s的命名空间中 使用导入命令将这三个包导入到k8s的命名空间中: docker load -i calico-cni.tar docker load -i calico-node.tar docker load -i calico-kube-controllers.tar 5. 导入之后就可以apply calico.yaml 文件了 6. 导入之后查看calico的pod,发现calico和coredns已经起来了 kubectl get pods -n kube-system NAME READY STATUS RESTARTS AGE calico-kube-controllers-8d76c5f9b-brv86 1/1 Running 0 22h calico-node-hxks2 1/1 Running 0 22h coredns-66f779496c-9hqsx 1/1 Running 0 23h coredns-66f779496c-rcc74 1/1 Running 0 23h etcd-kevin-pc 1/1 Running 4 (28m ago) 23h kube-apiserver-kevin-pc 1/1 Running 4 (28m ago) 23h kube-controller-manager-kevin-pc 1/1 Running 4 (28m ago) 23h kube-proxy-gglh4 1/1 Running 1 (28m ago) 23h kube-scheduler-kevin-pc 1/1 Running 4 (28m ago) 23h -

VNC一款超好用的局域网远程控制工具 VNC一款超好用的局域网远程控制工具 Vnc是一种远程桌面分享系统,它允许用户通过网络连接从另一台计算机控制另一台电脑的桌面环境。VNC基于RFB(Remote Framebuffer)协议,最初由AT&T的欧洲实验室于1998年开发。现在,VNC已经成为最流行的远程控制工具之一,被广泛应用于远程技术支持、远程工作、在线游戏以及访问受限的网络资源等场景。 安装步骤: 本软件分为服务端和客户端两部分。 服务端安装步骤 1.1首先解压压缩包,双击VNC-Server-6.7.2-Windows文件夹,然后打开VNC-Server-6.7.2-Windows.exe。 1.2 弹出的窗口选OK,然后点击next,新的界面先勾选再点击next。 1.3该窗口可以选择软件的安装路径,如果无特殊需求可以直接用默认的安装路径,点next;新弹出的窗口继续next;然后点击install。 1.4出现下图证明你的服务端已经安装成功了。 1.5该步骤是为服务器添加一个用于连接到这台主机的VNC账户密码,参考步骤如下图,执行完这5步后服务端就算彻底安装完毕了。 客户端安装 2.1打开文件夹VNC-Viewer-6.20.529-Windows,双击运行VNC-Viewer-6.20.529-Windows.exe;弹出的窗口点击ok 2.2到这里,客户端就算安装完毕了,下面进行客户端的使用操作 可以看到VNC已经远程成功了

VNC一款超好用的局域网远程控制工具 VNC一款超好用的局域网远程控制工具 Vnc是一种远程桌面分享系统,它允许用户通过网络连接从另一台计算机控制另一台电脑的桌面环境。VNC基于RFB(Remote Framebuffer)协议,最初由AT&T的欧洲实验室于1998年开发。现在,VNC已经成为最流行的远程控制工具之一,被广泛应用于远程技术支持、远程工作、在线游戏以及访问受限的网络资源等场景。 安装步骤: 本软件分为服务端和客户端两部分。 服务端安装步骤 1.1首先解压压缩包,双击VNC-Server-6.7.2-Windows文件夹,然后打开VNC-Server-6.7.2-Windows.exe。 1.2 弹出的窗口选OK,然后点击next,新的界面先勾选再点击next。 1.3该窗口可以选择软件的安装路径,如果无特殊需求可以直接用默认的安装路径,点next;新弹出的窗口继续next;然后点击install。 1.4出现下图证明你的服务端已经安装成功了。 1.5该步骤是为服务器添加一个用于连接到这台主机的VNC账户密码,参考步骤如下图,执行完这5步后服务端就算彻底安装完毕了。 客户端安装 2.1打开文件夹VNC-Viewer-6.20.529-Windows,双击运行VNC-Viewer-6.20.529-Windows.exe;弹出的窗口点击ok 2.2到这里,客户端就算安装完毕了,下面进行客户端的使用操作 可以看到VNC已经远程成功了 -

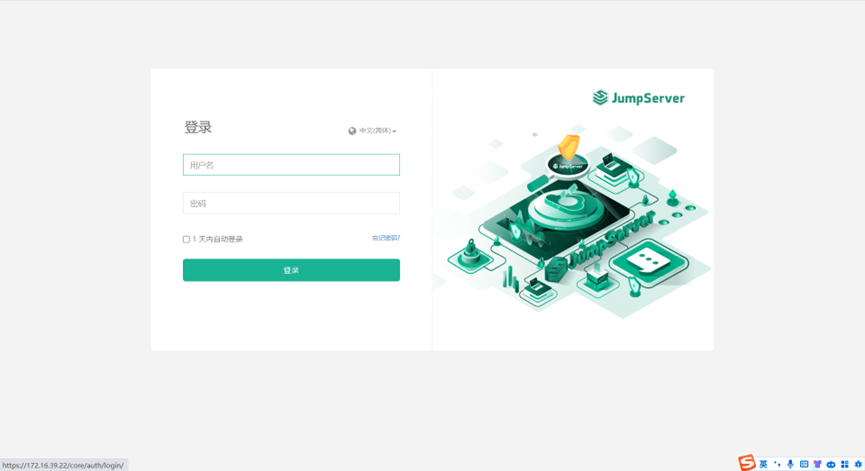

Jumper server 使用指导书 浏览器打开: https://堡垒机IP 登录jumper server堡垒机 ——下图表示登录成功,来到个人首页 点击”个人信息”旁切换按钮,切换到”工作台”,再点击“我的资产”,右侧就能看到此账号所授权的资产 点击资产右侧的“>_“会跳转到以下界面,点击连接,就可以直接远程到对应的资产 完成 文件上传 点击文件管理就能看到文件上传按钮 点击即可上传文件 文件下载: 在服务器文件管理器点击JumpServer-Lion 进入到\tsclient\JumpServer\Download目录 把文件拖拽进这个目录即可下载对应文件 复制粘贴使用 本地复制文本后点击剪切板即可复制进服务器内 Linux文件管理⚓︎ 1 批量传输⚓︎ • JumpServer 支持对文件进行批量传输,即将本地文件批量的上传到多个JumpServer纳管的资产中。 2 文件管理⚓︎ • 文件管理是传输文件的一种方式,上传下载默认 SFTP 目录默认为/tmp 路径。 • SFTP 目录与资产平台进行绑定,JumpServer 默认平台的 SFTP 目录无法修改(需联系管理员操作修改) 2.1 页面使用⚓︎ • 点击左侧节点树对应资产,即可进入资产中的 SFTP 目录。 • 进入 SFTP 目录后,即可对文件夹或文件对应操作。 • 操作方式支持两种,第一种方式:直接在右侧页面右击唤出操作菜单;第二种方式:上方黑色部分的按钮进行对应的操作。

Jumper server 使用指导书 浏览器打开: https://堡垒机IP 登录jumper server堡垒机 ——下图表示登录成功,来到个人首页 点击”个人信息”旁切换按钮,切换到”工作台”,再点击“我的资产”,右侧就能看到此账号所授权的资产 点击资产右侧的“>_“会跳转到以下界面,点击连接,就可以直接远程到对应的资产 完成 文件上传 点击文件管理就能看到文件上传按钮 点击即可上传文件 文件下载: 在服务器文件管理器点击JumpServer-Lion 进入到\tsclient\JumpServer\Download目录 把文件拖拽进这个目录即可下载对应文件 复制粘贴使用 本地复制文本后点击剪切板即可复制进服务器内 Linux文件管理⚓︎ 1 批量传输⚓︎ • JumpServer 支持对文件进行批量传输,即将本地文件批量的上传到多个JumpServer纳管的资产中。 2 文件管理⚓︎ • 文件管理是传输文件的一种方式,上传下载默认 SFTP 目录默认为/tmp 路径。 • SFTP 目录与资产平台进行绑定,JumpServer 默认平台的 SFTP 目录无法修改(需联系管理员操作修改) 2.1 页面使用⚓︎ • 点击左侧节点树对应资产,即可进入资产中的 SFTP 目录。 • 进入 SFTP 目录后,即可对文件夹或文件对应操作。 • 操作方式支持两种,第一种方式:直接在右侧页面右击唤出操作菜单;第二种方式:上方黑色部分的按钮进行对应的操作。 -

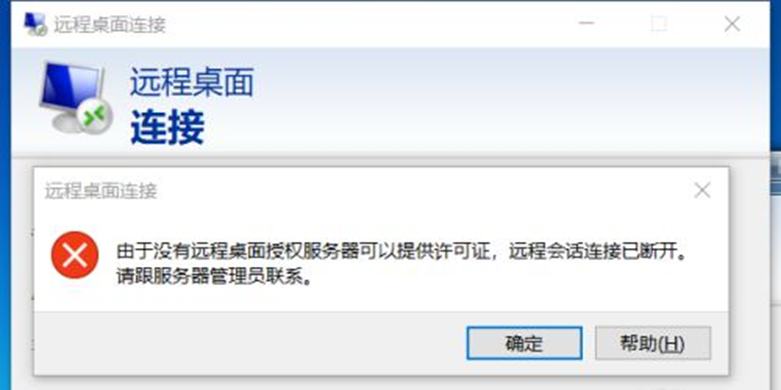

【Windows Server】由于没有远程桌面授权服务器可以提供许可 由于没有远程桌面授权服务器可以提供许可证,远程会话连接已断开。请跟服务器管理员联系。原因是服务器安装了远程桌面服务RemoteApp,这个是需要授权的。但是微软官方给予了120天免授权使用,超过120天还没有可用授权就会出现远程会话被中断,可修改注册表来延长使用期限,此方法win2008和win2012适用 1、 首先进入安装了远程桌面服务RemoteApp的服务器,我这里是win2012 2、 按 win+R 键 打开运行,输入regedit 然后按 确定 3、 然后就打开了注册表编辑器 4、 然后进入 HKEY_LOCAL_MACHINE \ SYSTEM \ CurrentControlSet \ Control \ Terminal Server \ RCM \ GracePeriod ,选中 GracePeriod 然后右键 点击 权限 选择Administrators , 把完全控制勾上,点击确定后提示:无法保存对GracePeriod权限所作的更改。 5、administrator权限赋予 回到GracePeriod,右键权限,点击高级 点击更改所有者 注意:这里选择的是Administrators,看上图中的图标。 更改所有者后在审核里进行添加 选择Administrators为主体后,在此处添加完全控制权限 6、、 选择Administrators , 然后把 完全控制 勾上 , 再按确定 7、、 选中注册表中的 REG_BINARY,然后右键 删除 8、、 选择 是 9、然后关掉注册表编辑器,重启服务器 10、重启服务器后就不会被中断了,此方法可以继续使用120天,等到120天到了再按此方法进行操作就可以再继续使用了

【Windows Server】由于没有远程桌面授权服务器可以提供许可 由于没有远程桌面授权服务器可以提供许可证,远程会话连接已断开。请跟服务器管理员联系。原因是服务器安装了远程桌面服务RemoteApp,这个是需要授权的。但是微软官方给予了120天免授权使用,超过120天还没有可用授权就会出现远程会话被中断,可修改注册表来延长使用期限,此方法win2008和win2012适用 1、 首先进入安装了远程桌面服务RemoteApp的服务器,我这里是win2012 2、 按 win+R 键 打开运行,输入regedit 然后按 确定 3、 然后就打开了注册表编辑器 4、 然后进入 HKEY_LOCAL_MACHINE \ SYSTEM \ CurrentControlSet \ Control \ Terminal Server \ RCM \ GracePeriod ,选中 GracePeriod 然后右键 点击 权限 选择Administrators , 把完全控制勾上,点击确定后提示:无法保存对GracePeriod权限所作的更改。 5、administrator权限赋予 回到GracePeriod,右键权限,点击高级 点击更改所有者 注意:这里选择的是Administrators,看上图中的图标。 更改所有者后在审核里进行添加 选择Administrators为主体后,在此处添加完全控制权限 6、、 选择Administrators , 然后把 完全控制 勾上 , 再按确定 7、、 选中注册表中的 REG_BINARY,然后右键 删除 8、、 选择 是 9、然后关掉注册表编辑器,重启服务器 10、重启服务器后就不会被中断了,此方法可以继续使用120天,等到120天到了再按此方法进行操作就可以再继续使用了 -

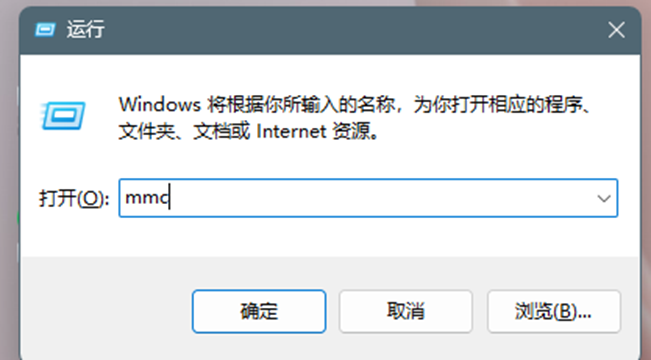

Exchange 2013/2016安装SSL证书步骤 Exchange分为2013和2016版,安装SSL证书的步骤教程大致相同,主要分为导入SSL证书、绑定SSL证书2大步骤,您可以参考以下步骤为Exchange 2013/2016安装SSL证书。 一、导入SSL证书 1、首先需要导入SSL证书,键盘同时按住 win+r 进入运行对话框,在运行对话框中输入“mmc”,点击“确定”进入控制台 2、在控制台界面依次点击“文件”-“添加/删除管理单元” 3、然后选择“证书”,点击“添加”进入证书管理单元 4、在证书管理单元选择“计算机账户”,然后点击“下一页” 5、选择计算机默认,然后进入下一步 6、在“个人”-“证书”处右击,选择“所有任务”-“导入”进入证书导入向导界面 7、在证书导入向导界面中选择“浏览” 8、随后选择我们提供的压缩包里IIS文件夹中的pfx格式的证书,例如“racent_com.pfx” 9、输入IIS文件夹中password文件中的密码,然后点击“下一页” 10、选中“将所有的证书都放入下列存储”,然后证书储存设置为“个人”,然后点击“下一页” 11、这样就导入SSL证书了,导入成功后会显示完整的三个证书 二、绑定SSL证书 1、接下来要绑定应用您的SSL证书,请返回到Exchange管理中心。在“服务器”-“证书”中,选择正确服务器,找到导入的证书,选择该证书,点击“编辑” 2、随后单击左侧的“服务Services”按钮,选择要使用证书服务,单击“保存save”按钮即可 以上步骤操作完毕,现在,您的证书已成功安装并启用。

Exchange 2013/2016安装SSL证书步骤 Exchange分为2013和2016版,安装SSL证书的步骤教程大致相同,主要分为导入SSL证书、绑定SSL证书2大步骤,您可以参考以下步骤为Exchange 2013/2016安装SSL证书。 一、导入SSL证书 1、首先需要导入SSL证书,键盘同时按住 win+r 进入运行对话框,在运行对话框中输入“mmc”,点击“确定”进入控制台 2、在控制台界面依次点击“文件”-“添加/删除管理单元” 3、然后选择“证书”,点击“添加”进入证书管理单元 4、在证书管理单元选择“计算机账户”,然后点击“下一页” 5、选择计算机默认,然后进入下一步 6、在“个人”-“证书”处右击,选择“所有任务”-“导入”进入证书导入向导界面 7、在证书导入向导界面中选择“浏览” 8、随后选择我们提供的压缩包里IIS文件夹中的pfx格式的证书,例如“racent_com.pfx” 9、输入IIS文件夹中password文件中的密码,然后点击“下一页” 10、选中“将所有的证书都放入下列存储”,然后证书储存设置为“个人”,然后点击“下一页” 11、这样就导入SSL证书了,导入成功后会显示完整的三个证书 二、绑定SSL证书 1、接下来要绑定应用您的SSL证书,请返回到Exchange管理中心。在“服务器”-“证书”中,选择正确服务器,找到导入的证书,选择该证书,点击“编辑” 2、随后单击左侧的“服务Services”按钮,选择要使用证书服务,单击“保存save”按钮即可 以上步骤操作完毕,现在,您的证书已成功安装并启用。